O confronto entre o governo Trump e a Anthropic, empresa responsável pelo modelo de inteligência artificial Claude, chegou ao Judiciário — e, por ora, a startup saiu vencedora. Uma juíza federal em São Francisco concedeu liminar à empresa, suspendendo temporariamente as medidas que buscavam restringir o uso de sua tecnologia por órgãos do governo federal americano.

O estopim do conflito

A crise entre a Anthropic e a Casa Branca tem raízes em negociações fracassadas sobre o uso dos modelos da empresa em plataformas de inteligência artificial do Departamento de Defesa. O impasse era de natureza ética: enquanto o governo buscava acesso amplo à tecnologia para todos os usos permitidos em lei, a Anthropic exigia garantias de que seus sistemas não seriam empregados em armas totalmente autônomas ou em programas de vigilância doméstica em massa.

Sem acordo, a situação escalou rapidamente. O Pentágono declarou publicamente a Anthropic um risco para a cadeia de suprimentos — classificação historicamente reservada a empresas de países adversários, como China e Rússia. A medida teve consequências práticas imediatas: grandes contratadas de defesa, incluindo Amazon, Microsoft e Palantir, passaram a ser obrigadas a certificar que não utilizam os modelos da companhia em trabalhos militares.

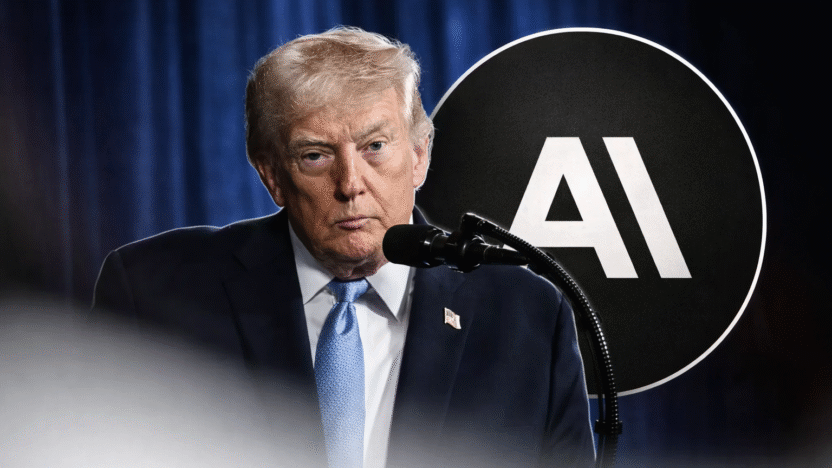

Em paralelo, o presidente Donald Trump foi ainda mais longe e ordenou, em rede social, que agências federais deixassem de usar qualquer tecnologia da Anthropic, rotulando publicamente a empresa como uma “companhia de IA radical de esquerda.”

A resposta nos tribunais

Diante dos danos financeiros e reputacionais gerados pelas medidas, a Anthropic decidiu recorrer à Justiça. A empresa argumentou que as ações do governo configuravam retaliação pelo posicionamento crítico que havia adotado durante as negociações contratuais e a juíza Rita Lin concordou.

Em sua decisão, Lin foi direta ao classificar a situação: punir a Anthropic por trazer escrutínio público à posição contratual do governo seria um caso clássico de retaliação ilegal, protegida pela Primeira Emenda da Constituição americana, que garante a liberdade de expressão.

A magistrada também questionou a base legal usada pelo Pentágono, afirmando que nenhuma legislação autoriza que uma empresa americana seja rotulada como potencial adversária e sabotadora dos Estados Unidos simplesmente por discordar do governo.

O que a liminar muda e o que ainda está por vir

A decisão impede temporariamente a administração Trump de implementar, aplicar ou fazer cumprir a diretiva presidencial contra a Anthropic. Também limita a tentativa do Pentágono de manter a classificação da empresa como ameaça à segurança nacional.

No entanto, a liminar é uma medida provisória. Uma decisão definitiva sobre a legalidade das ações do governo ainda deve levar meses, e o desfecho do caso poderá ter impacto direto sobre como empresas de inteligência artificial se relacionam e discordam com o poder público nos Estados Unidos.

O caso coloca em evidência uma tensão crescente no setor: à medida que a IA se torna peça central nas estratégias de defesa e segurança nacional, os limites éticos impostos por suas criadoras passam a ser tratados, por alguns governos, como obstáculos ou até ameaças.

Fonte: InfoMoney