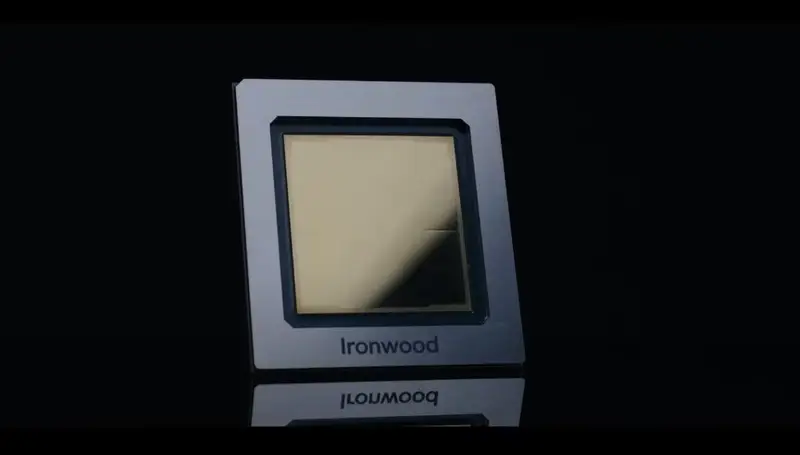

O Google apresentou o Ironwood, seu chip de sétima geração para aceleração de IA, projetado para a nova era da inferência em grande escala. O novo TPU v7 entrega mais de quatro vezes o desempenho do modelo anterior, o v6e “Trillium”, e se aproxima dos GPUs Blackwell da Nvidia em potência de cálculo. As informações são do The register

Cada unidade Ironwood alcança 4,6 petaFLOPS em FP8, superando o Nvidia B200 e ficando pouco abaixo das versões mais potentes da linha Blackwell. O chip traz ainda 192 GB de memória HBM3e com 7,4 TB/s de largura de banda, configuração que coloca o TPU no mesmo patamar dos aceleradores mais recentes do mercado.

O avanço mais significativo, porém, está na capacidade de escala. O Ironwood pode operar em superpods de até 9.216 chips, permitindo que empresas treinem e executem modelos gigantes com menor latência e maior eficiência. Segundo o Google, sua infraestrutura pode, em teoria, conectar até 43 pods, formando clusters com centenas de milhares de TPUs interligadas. O sistema utiliza uma topologia em torus 3D combinada com switches ópticos, tecnologia que reduz latência e permite reconfigurar o cluster rapidamente em caso de falhas.

O lançamento ocorre em um momento de crescente concorrência entre grandes empresas de IA. A capacidade de escalar aceleradores em domínios massivos já atrai clientes como a Anthropic, que planeja utilizar até um milhão de TPUs para treinar seus próximos modelos Claude.

Com o Ironwood, o Google mostra que chips dedicados à IA, como TPUs e ASICs, avançam rapidamente e já oferecem desempenho comparável ao dos GPUs mais avançados. A disputa com Nvidia e AMD passa a depender menos da força bruta de hardware e mais da eficiência de rede, arquitetura de data centers e integração com software.

Créditos na imagem: Divulgação/Google